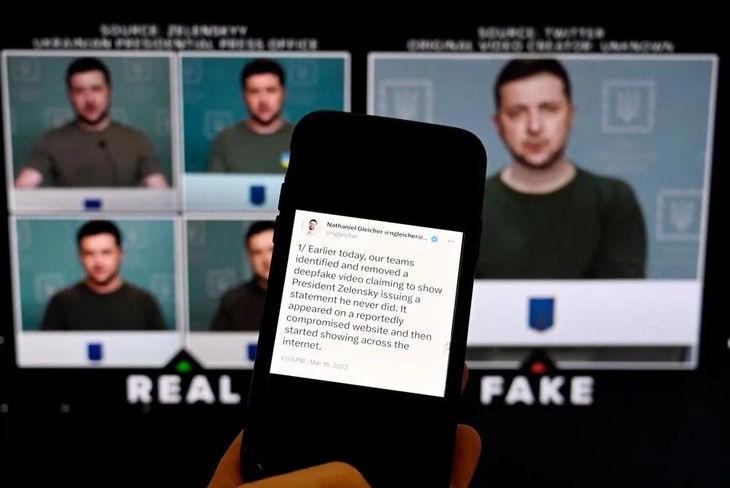

Một video giả mạo phát biểu của Tổng thống Ukraine Volodymyr Zelensky bằng công nghệ deepfake - Ảnh: AFP

Variety đưa tin từ báo cáo quý 1-2025 của Resemble AI, số tiền thiệt hại do deepfake gây ra đã vượt ngưỡng 200 triệu USD, chủ yếu đến từ các vụ lừa đảo tài chính, thao túng chính trị, tống tiền và phát tán nội dung nhạy cảm được AI tạo ra để trục lợi.

Báo cáo mô tả đây là một "cuộc khủng hoảng đang leo thang" với các hình thức tấn công ngày càng tinh vi, vượt xa khả năng nhận diện của người dùng thông thường.

Ai là nạn nhân của deepfake?

Ban đầu, deepfake xuất hiện như một trò chơi công nghệ mang tính giải trí. Nhưng chỉ sau vài năm, công nghệ này đã biến thành công cụ đắc lực trong các chiến dịch lừa đảo xuyên quốc gia.

Theo Resemble AI, deepfake hiện được sử dụng chủ yếu trong video (46%), tiếp theo là hình ảnh (32%) và âm thanh (22%).

Đáng lo ngại, chỉ cần 3 đến 5 giây mẫu ghi âm, kẻ xấu đã có thể tạo ra bản giả giọng đủ sức đánh lừa người thân, đối tác hay thậm chí cả hệ thống xác minh tự động.

Trên thế giới, Hàn Quốc chắc chắn là một trong những nơi thực trạng này diễn biến phức tạp nhất, với nhiều nhóm chat chuyên ghép các thần tượng vào nội dung khiêu dâm để bán - Ảnh: X

Không chỉ vậy, 68% các sản phẩm deepfake hiện nay được đánh giá là "gần như không thể phân biệt với nội dung thật", khiến việc phát hiện trở nên cực kỳ khó khăn, ngay cả với các chuyên gia công nghệ.

Sự kết hợp giữa hình ảnh và âm thanh trong một video đồng bộ khiến những vụ mạo danh trở nên đáng tin đến mức người thật cũng khó nhận ra mình đang bị lợi dụng.

Báo cáo cho thấy 41% nạn nhân là nhân vật của công chúng, chủ yếu là chính trị gia và người nổi tiếng, nhưng 34% còn lại là công dân bình thường.

Nguy cơ từ deepfake không còn giới hạn trong giới nổi tiếng mà đã lan đến mọi tầng lớp xã hội. Các tổ chức tài chính, doanh nghiệp và cơ quan chính phủ cũng không nằm ngoài danh sách bị nhắm đến.

Bắc Mỹ chiếm 38% số vụ việc, trong đó phần lớn liên quan đến các nhân vật chính trị. Châu Á chiếm 27%, còn châu Âu là 21%.

63% các vụ tấn công có yếu tố xuyên biên giới, chứng minh rằng deepfake không chỉ là vấn đề trong nước, mà đã trở thành mối đe dọa toàn cầu.

Lừa đảo ngày càng tinh vi trên toàn cầu

Trong số các chiêu trò lừa đảo bằng deepfake, nội dung nhạy cảm là hình thức phổ biến nhất, gây tổn hại nặng nề đến danh tiếng và tinh thần nạn nhân.

Kế đến là các chiêu lừa tài chính, như giả danh sếp để yêu cầu chuyển tiền, giả mạo người thân cần giúp đỡ khẩn cấp, hoặc thậm chí dựng cảnh gọi video để xác minh giả mạo danh tính.

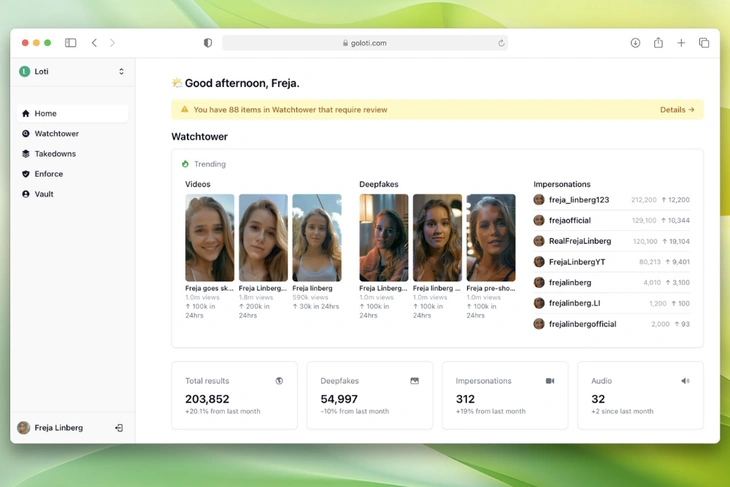

Mặt khác, các ứng dụng chống deepfake cũng được phát triển ngày càng mạnh mẽ, trên ảnh là Loti AI, vừa gọi vốn thành công hơn 16 triệu USD - Ảnh: Variety

Một lĩnh vực khác bị deepfake tấn công mạnh là chính trị, với các video cắt ghép lời nói của lãnh đạo nhằm gây hoang mang dư luận hoặc thao túng thông tin trong mùa bầu cử.

Ngoài ra, tin giả và sai lệch thông tin cũng được khuếch đại bởi công nghệ này, đẩy nhanh tốc độ lan truyền nhờ vẻ ngoài thuyết phục của các đoạn nội dung.

Đại diện của Resemble AI nhấn mạnh trong công bố: "Cuộc chiến chống deepfake cần một phản ứng đa tầng và toàn cầu.

Trong đó, các giải pháp công nghệ phải đi đầu, bao gồm: phát triển hệ thống phát hiện deepfake hiệu quả hơn, chuẩn hóa giao thức xác thực nội dung bằng watermark, và các cơ chế xác minh kỹ thuật số có thể truy xuất nguồn gốc".

Báo cáo cũng kêu gọi sự vào cuộc của chính phủ các nước để ban hành khung pháp lý đồng bộ, định nghĩa rõ ràng về deepfake gây hại, quy trách nhiệm cho các nền tảng lưu trữ và thiết lập cơ chế xử phạt hiệu quả.

Việc tuyên truyền nâng cao nhận thức cộng đồng, đặc biệt qua chương trình giáo dục kỹ năng số và truyền thông cũng được xem là mấu chốt giúp công chúng phòng vệ tốt hơn.

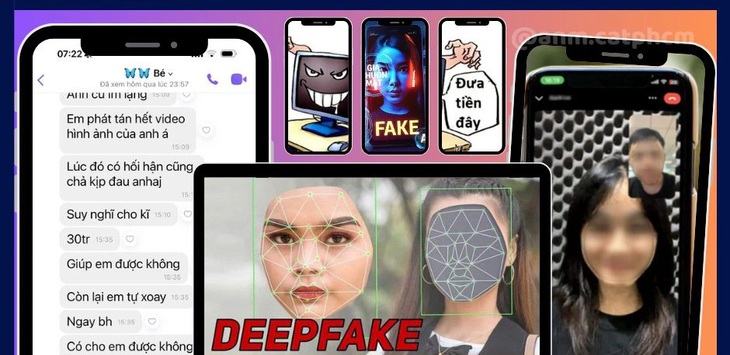

Tại Việt Nam, tuy cách thức chưa tinh vi bằng nhưng đã có vô số nạn nhân mắc bẫy, Phòng an ninh mạng và phòng chống tội phạm sử dụng công nghệ cao liên tục cảnh báo - Ảnh: PA05

Tại Việt Nam, các chiêu trò lừa đảo sử dụng deepfake cũng đang có dấu hiệu gia tăng rõ rệt, với nhiều tình huống gây hoang mang cho cộng đồng mạng.

Một số nạn nhân kể lại, họ thậm chí nhận được cuộc gọi video call với giọng nói và cách nói chuyện y hệt người thân, khiến họ không chút nghi ngờ.

Khi đã chiếm được niềm tin, kẻ gian tiếp tục yêu cầu "giúp đỡ khẩn cấp" như chuyển tiền, cung cấp mã xác thực, hoặc nhờ mượn tài khoản ngân hàng.

Trước thực trạng này, các chuyên gia công nghệ cảnh báo: deepfake đang trở thành vũ khí lừa đảo cực kỳ nguy hiểm, và Việt Nam cần sớm chuẩn hóa khung pháp lý để bảo vệ người dùng.

Tối đa: 1500 ký tự

Hiện chưa có bình luận nào, hãy là người đầu tiên bình luận